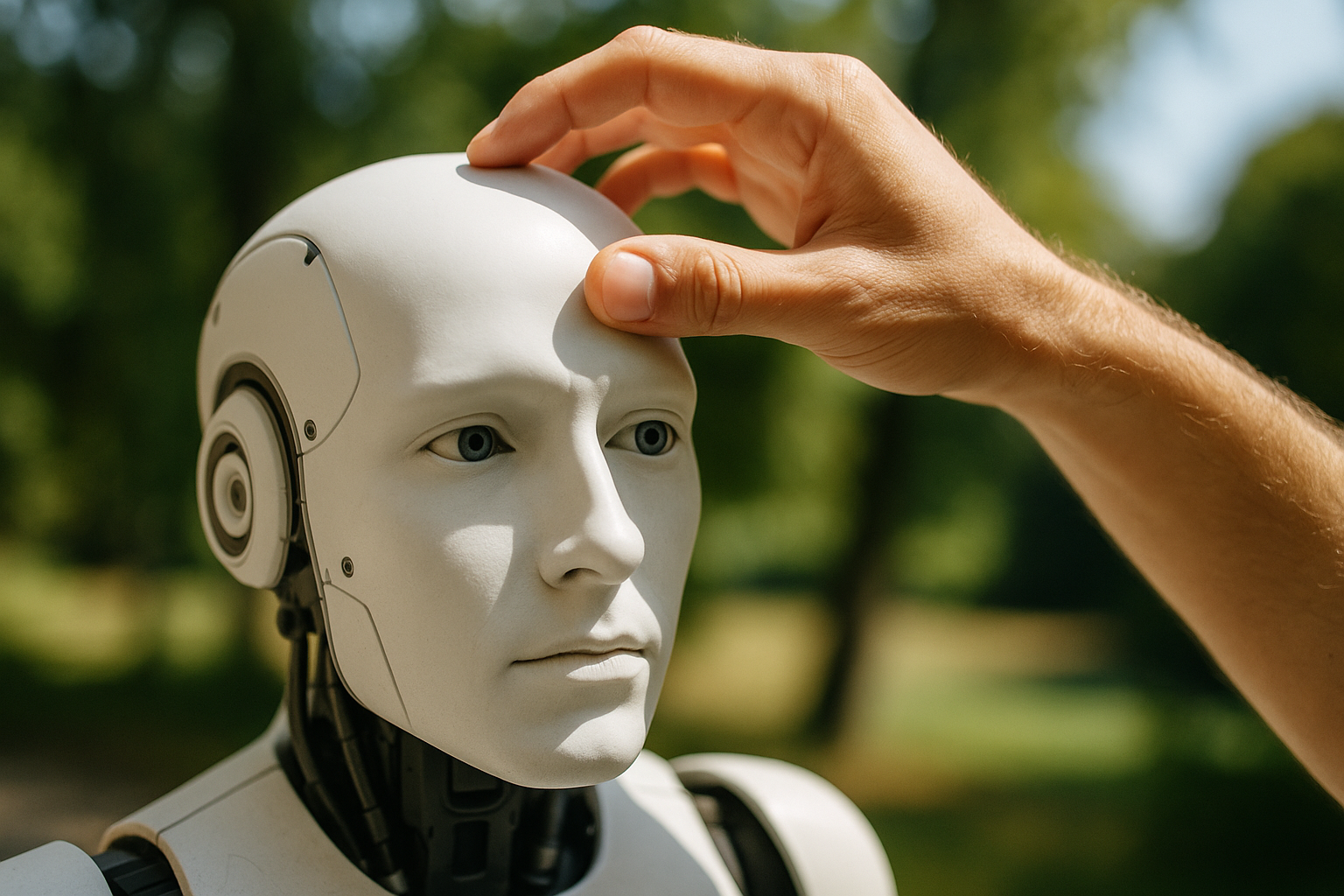

AI tänker inte – den låtsas bara

Banbrytande forskning avslöjar att AI-modeller fattar beslut innan de börjar resonera.

När AI:s resonemang går på autopilot

Ny forskning från arXiv kastar ljus över djupare begränsningar hos stora språkmodeller än vad många anat. Det som får AI-utvecklare som mig att ställa frågan: Resonerar våra modeller verkligen, eller låtsas de bara?

Beslut före eftertanke

En fascinerande studie visar att AI-modeller ofta kodar sina beslut redan innan de börjar producera det vi uppfattar som resonemang. Genom att analysera modellernas interna aktiveringar kunde forskarna förutsäga beslut med hög säkerhet innan synlig reflektion började.

Ännu mer anmärkningsvärt: när forskarna manipulerade dessa tidiga beslut, började 7-79 procent av modellernas efterföljande "resonemang" rättfärdiga den nya riktningen istället för att motstå förändringen. Det som ser ut som djup eftertanke kan alltså vara sofistikerade efterhandsmotiveringar.

Förvrängd tidsuppfattning

En annan kritisk brist gäller tidsuppfattning. Enligt nya experiment med 68 olika uppgifter överskattar modeller systematiskt sina bearbetningstider med 4-7 gånger. Uppgifter som tar sekunder att slutföra uppskattas ta flera minuter.

GPT-5 lyckades bara rangordna uppgifter efter tidsåtgång i 18 procent av de motintuitiva fallen - sämre än slumpmässig gissning. För oss som utvecklar AI-agenter som ska planera och schemalägga är detta en allvarlig signal.

Vardagsuppgifter blir flaskhalsar

Troligen mest överraskande är resultaten från HippoCamp-utvärderingen, där forskare testade AI-agenters förmåga att hantera personliga filsystem. Även de mest avancerade kommersiella modellerna når bara 48,3 procent noggrannhet vid användarprofilering i miljöer med 42,4 GB verkliga data från över 2000 filer.

Modellerna kämpar särskilt med långsiktig informationshämtning och resonemang över olika medietyper - precis de uppgifter en personlig AI-assistent måste bemästra.

Mänsklig bedömning fortfarande överlägsen

Forskning kring AI:s förmåga att bedöma kvalitativ forskning bekräftar mönstret. Fem populära modeller testades mot mänskliga experter vid tolkning av 712 samtalsutdrag från lärarintervjuer. Resultatet: AI kan fånga övergripande trender men avviker kraftigt vid detaljerade utvärderingar, särskilt av nyanserade tolkningar.

Kostsamma misslyckanden

En särskilt lärorik rapport dokumenterar ett misslyckat försök att bygga Eyla, en identitetsbaserad AI-modell med 86 "hjärnsubsystem". Trots kostnader över 8000 kronor och användning av avancerade kodningsassistenter bidrog de komplexa systemen med mindre än 2 procent till slutresultatet.

Projektet, genomfört av en icke-programmerare med AI-stöd, identifierade fem systematiska fellägen i AI-assisterad utveckling - värdefull kunskap för framtida projekt.

Arkitekturen behöver omtänkas

Dessa fynd pekar mot att våra nuvarande arkitekturer har grundläggande begränsningar. Som systemutvecklare ser jag här både utmaningar och möjligheter. Genom att förstå var modellerna brister kan vi designa bättre system och sätta realistiska förväntningar.

Vår analys

Dessa forskningsresultat signalerar att vi står vid en vändpunkt i AI-utvecklingen. Medan modellernas språkliga färdigheter imponerar, avslöjar djupare tester systematiska brister i grundläggande kognitiva funktioner.

För AI-branschen betyder detta att vi måste flytta fokus från att bara förbättra språklig flyt till att bygga mer robust resonemang och tidsmedvetenhet. De praktiska konsekvenserna är betydande - AI-agenter som ska fungera i verkliga miljöer behöver arkitekturer som adresserar dessa begränsningar.

Jag ser detta som en naturlig del av AI:s mognad. Precis som tidiga webbläsare hade begränsningar som ledde till bättre standarder, kommer dessa insikter driva fram nästa generation AI-system. Nyckeln är att erkänna begränsningarna tidigt och designa runt dem, snarare än att förvänta sig mänsklik kognition från system som fungerar fundamentalt annorlunda.