Svenska forskare skapar AI som planerar 48 gånger snabbare – andra utvecklar förklarbar AI

Svenska forskare skapar AI som planerar 48 gånger snabbare.

Svenska forskare revolutionerar AI-träning

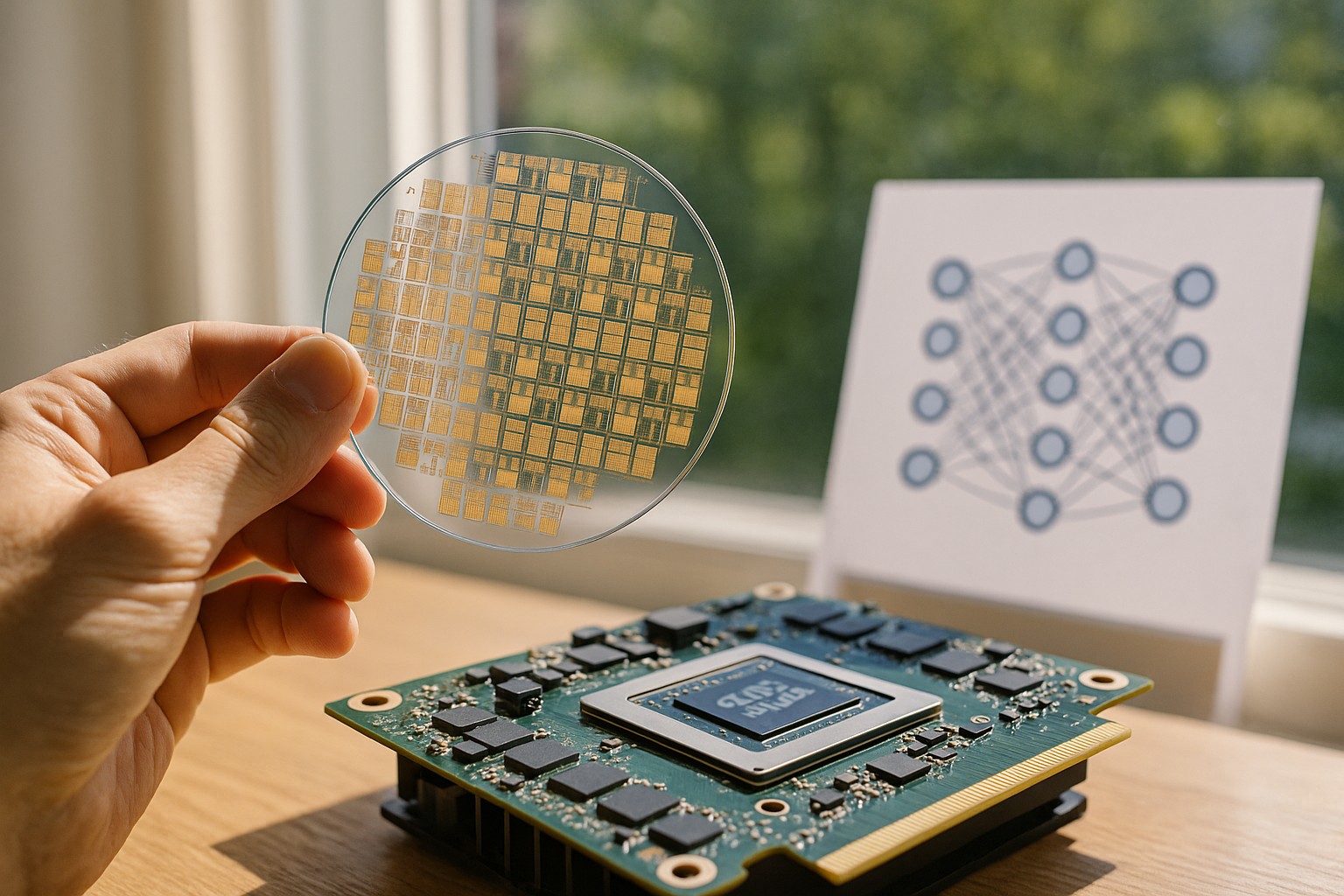

Svenska forskare har utvecklat LeWorldModel (LeWM), en banbrytande arkitektur som radikalt förenklar hur AI-system lär sig förstå omvärlden. Till skillnad från tidigare metoder som krävde komplexa träningsprocesser och sex olika justerbara parametrar, använder LeWM endast en enda parameter för stabil träning direkt från råa pixlar.

Med sina 15 miljoner parametrar kan modellen tränas på ett enda grafikkort på bara några timmar – en dramatisk förbättring från tidigare världsmodeller. Ännu mer imponerande är att LeWM planerar upp till 48 gånger snabbare än världsmodeller baserade på stora grundmodeller, samtidigt som den förblir konkurrenskraftig över olika styruppgifter.

AI lär sig tänka som en schackmästare

Parallellt har andra forskare utvecklat en teknik kallad "mästardestillation" som överför expertkunskap till språkmodeller på ett helt nytt sätt. Genom att fånga hela resonemangsprocessen från expertsystem och omvandla den till naturliga förklaringar har de skapat modellen C1 med 4 miljarder parametrar.

Resultaten inom schack är slående: modellen förbättrade sin träffsäkerhet från nära noll till 48,1 procent och överträffar nu alla öppna källkodsmodeller samt de flesta kommersiella system. Till skillnad från tidigare neurala schackmetoder kan C1 förklara sitt strategiska tänkande och använder betydligt färre beräkningsresurser.

Djupare förståelse av hur AI fungerar

Flera studier ger nya insikter i AI-modellers inre liv. Forskning på SmolLM2-135M avslöjar att olika lager har drastiskt olika betydelse – vissa lager kan försämra prestandan med över 63 000 procent om de tas bort, medan andra faktiskt förbättrar modellen när de försvinner.

Denna upptäckt ledde till "Growth Transformer Training" som fördelar beräkningsresurser efter lagers betydelse istället för jämnt. Metoden uppnådde 54 procent kostnadsminskning och 4,7 gånger lägre valideringsförlust jämfört med traditionell träning.

Snabbare generering utan kvalitetsförlust

Warm-Start Flow Matching (WS-FM) löser ett av de största problemen med dagens AI-generering: den långa väntetiden. Istället för att börja från ren slump använder metoden en snabb modell för att skapa ett utkast som sedan förfinas av en mer avancerad modell. Forskarna garanterar hastighetsökning utan kvalitetsförsämring.

Annan forskning visar att AI-modeller utvecklar metakognitiva förmågor – förmågan att reflektera över sina egna processer. Det nya ramverket Introspect-Bench kan skilja mellan äkta självreflektion och tillämpning av allmän kunskap, vilket ger viktiga insikter om hur AI-system utvecklar mer mänskliga kognitiva egenskaper.

Nya verktyg för genomskinlighet

GeoLAN-ramverket behandlar tokenrepresentationer som geometriska banor och använder matematiska principer för att göra språkmodeller mer genomskinliga. Metoden bibehåller noggrannhet samtidigt som den minskar partiskhet, särskilt hos medelstora modeller.

Parallellt utvecklas "Context Cartography" för att strukturerat styra hur modeller hanterar kontextuell information, medan LECT kombinerar språkmodellers semantiska förståelse med energibaserad inlärning för bättre avvikelsedetektering i textbaserade nätverk.

Vår analys

Dessa forskningsgenombrott signalerar en mognad inom AI-forskningen där fokus skiftar från att bara bygga större modeller till att bygga smartare modeller. De svenska världsmodellerna visar att dramatiska prestandaförbättringar är möjliga genom arkitektoniska innovationer snarare än bara mer beräkningskraft.

Särskilt intressant är hur mästardestillation öppnar för överföring av expertkunskap från specialiserade system till generella språkmodeller. Detta kan revolutionera hur vi tränar AI inom områden där data är begränsad men expertis finns tillgänglig – från medicinsk diagnostik till ingenjörskonst.

Upptäckten att AI-modeller spontant utvecklar metakognitiva förmågor utan explicit träning tyder på att vi närmar oss mer sofistikerade former av maskinell intelligens. Kombinerat med förbättrad genomskinlighet och förståelse för modellers inre funktioner, pekar utvecklingen mot AI-system som inte bara är kraftfullare, utan också mer förklarliga och därmed mer trovärdiga för kritiska tillämpningar.