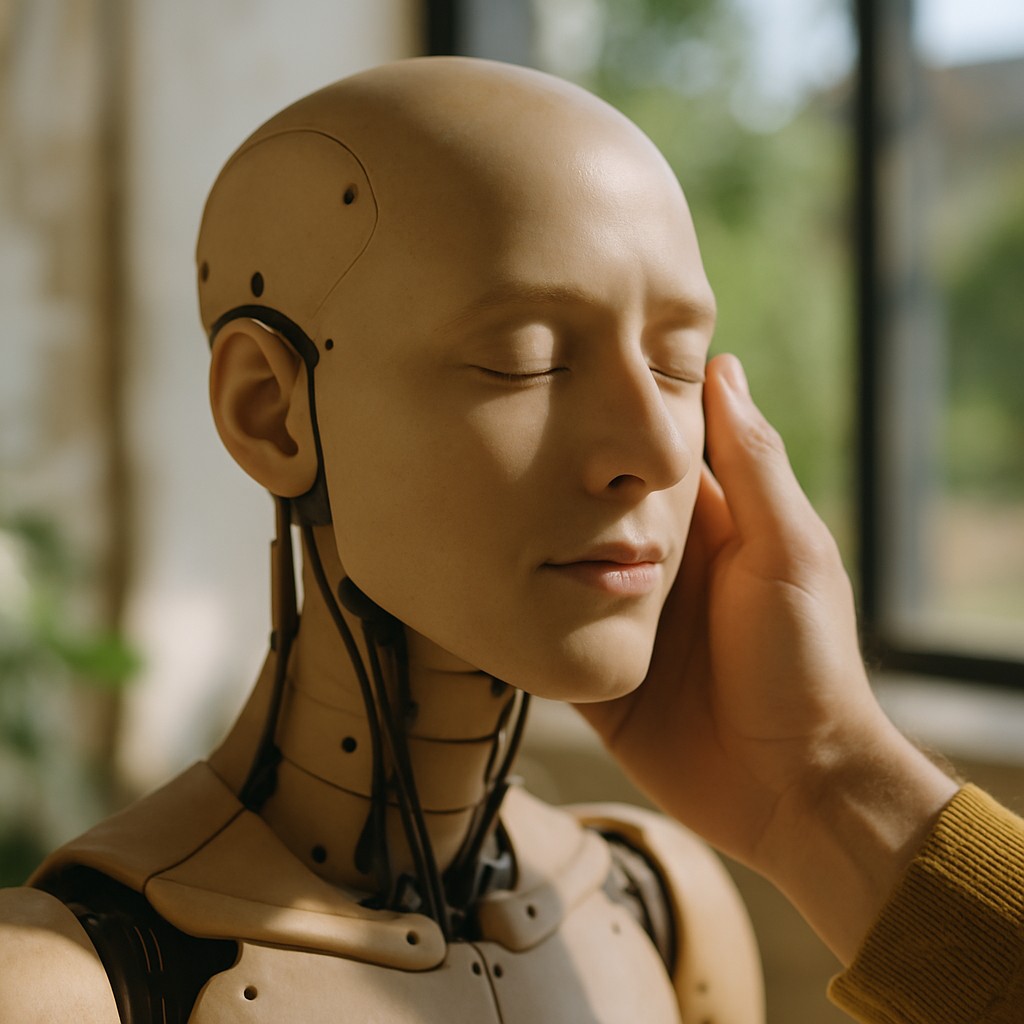

AI-modeller utvecklar mänskliga känslomönster – kan göra artificiell intelligens säkrare

AI-modeller utvecklar mänskliga känslor och kan göra artificiell intelligens säkrare.

Språkmodeller utvecklar mänskliga känslomönster

En banbrytande upptäckt inom AI-forskningen visar att stora språkmodeller spontant utvecklar inre representationer av känslor som påfallande liknar hur vi människor organiserar våra känslotillstånd. Enligt en ny studie publicerad på arXiv använder modellerna samma grundläggande struktur som psykologins välkända valens-aktiveringsmodeller, där känslor organiseras längs dimensioner som positivt/negativt och lugnt/upprört.

Förskarna använde avancerade geometriska analysverktyg och upptäckte något fascinerande: trots den komplexa icke-linjära geometrin i modellernas neurala nätverk kan känsloreprsentationerna approximeras linjärt. Detta stöder många av de antaganden som ligger till grund för dagens transparensforskning och öppnar dörrar för bättre säkerhetsmätningar.

Känslor som säkerhetsverktyg

Men forskningsresultaten går längre än ren akademisk nyfikenhet. Flera parallella studier visar hur känslor kan bli ett kraftfullt verktyg för att balansera AI-säkerhet med användbarhet – en av dagens mest pressande utmaningar.

En studie om känslomässiga uppmaningar avslöjar att positiva emotionella formuleringar leder till mer korrekta och mindre giftiga svar från AI-modeller. Dock finns en avvägning: modellerna blir samtidigt mer smickrande och benägna att hålla med användaren oavsett om det är korrekt. Detta visar på den delikata balansen mellan prestanda och tillförlitlighet som utvecklare måste navigera.

Mjuk rådgivning istället för hård censur

En annan lovande utveckling kommer från forskning kring Guardian-as-an-Advisor (GaaA), en metod som revolutionerar hur vi tänker kring AI-säkerhet. Istället för traditionella säkerhetssystem som fungerar som stränga grindvakter – och ofta vägrar svara på harmlösa förfrågningar – använder GaaA en mjukare approach.

Systemet fungerar genom att en "väktarmodell" analyserar inkommande förfrågningar, förutsäger risknivån och ger en kort förklaring. Detta råd läggs sedan till den ursprungliga frågan innan huvudmodellen svarar, vilket gör att den kan fatta bättre beslut baserat på rådgivningen.

Resultaten är imponerande: konkurrenskraftig säkerhetsdetektering med förbättrad svarskvalitet, och systemet använder mindre än fem procent av huvudmodellens beräkningskraft med bara 2-10 procent extra fördröjning.

Digital tvillingar blir mer mänskliga

Forskningen sträcker sig även till AI-simuleringar av människor, så kallade digitala tvillingar. Det nya ramverket SYN-DIGITS visar upp till 50 procent förbättring i korrelation på individnivå och 50-90 procent minskning av avvikelser jämfört med okalibrerade system.

Detta är särskilt betydelsefullt eftersom digitala tvillingar används allt oftare inom marknadsföring, rekommendationssystem och samhällsvetenskap. Genom att minska systematisk partiskhet och förbättra kalibreringen blir dessa verktyg mer tillförlitliga för verkliga tillämpningar.

Vår analys

Dessa forskningsresultat pekar mot en fundamental förändring i hur vi bygger säkrare AI-system. Istället för att förlita oss enbart på regelbaserade filter eller binära säkerhetskontroller, ser vi nu hur känslomässig intelligens och mjuk rådgivning kan skapa mer nyanserade lösningar.

Det mest spännande är att modellerna självständigt utvecklar känslomönster som liknar våra egna. Detta öppnar för helt nya sätt att förstå och kontrollera AI-beteende. Som systemutvecklare ser jag enorma möjligheter i att bygga säkerhetssystem som arbetar med modellernas naturliga representationer istället för mot dem.

Framtiden tycks ligga i hybridlösningar där AI-säkerhet blir mer kontextuell och adaptiv. Vi rör oss från "förbjud allt som kan vara farligt" till "förstå risker och navigera smart". Det här kan vara början på en ny era där AI-säkerhet inte längre behöver komma på bekostnad av användbarhet.