Var tjugonde förfrågan till företags-AI kan vara ett manipulationsförsök

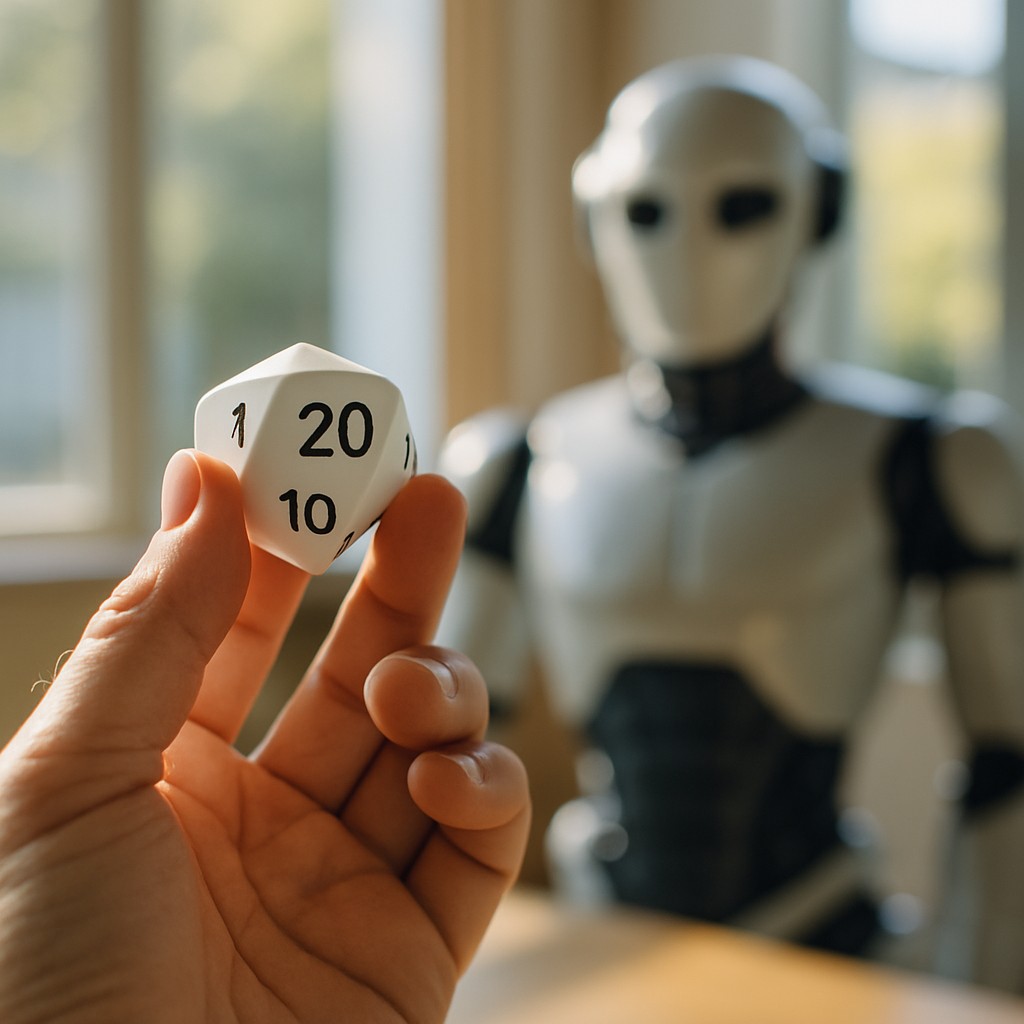

Var tjugonde förfrågan till företags-AI kan vara ett manipulationsförsök från kriminella.

Från AI-experiment till säkerhetskris

När generativ AI flyttar från testlabb till kundmöten upptäcker företag en obehaglig sanning: deras chattbotar har blivit mål för organiserade cyberbrottslingar. Det som började som roliga experiment på sociala medier – att lura Amazons kundtjänstbot att leverera matrecept istället för produktsupport – har utvecklats till systematiskt missbruk som kan få AI-kostnaderna att explodera.

Cybersäkerhetskonsulten Brian Levine från Former Gov är tydlig: "Företag som förlitar sig på passiva kontroller kommer att se kostnaderna skena iväg. De som bygger in aktiv styrning i sin arkitektur behåller kontrollen."

Dyrare än traditionella cyberattacker

Det som gör dessa AI-attacker särskilt farliga är kostnadsstrukturen. Varje interaktion med en avancerad språkmodell kostar pengar – ofta betydligt mer per förfrågan än traditionell dataöverföring. När brottslingar lyckas manipulera företagens chattbotar att utföra komplexa beräkningar eller generera omfattande innehåll, stjäl de inte bara data utan direkt AI-kapacitet som företaget betalar för.

Levine betonar att så kallad "jailbreaking" – metoder för att kringgå AI-begränsningar – måste behandlas som en förstahandsrisk: "Bygg för en värld där fem procent av trafiken försöker manipulera din bot, avsiktligt eller inte."

Forskning avslöjar dolda säkerhetsbrister

Parallellt med de praktiska attackerna visar ny akademisk forskning att AI-säkerhetsproblemen är djupare än många anat. Forskare har utvecklat en testmetod kallad Accelerated Prompt Stress Testing (APST) som avslöjar säkerhetsbrister som inte syns vid traditionell testning.

Problemet ligger i upprepning. Medan nuvarande säkerhetstester fokuserar på att testa AI-modeller över många olika uppgifter, missar de hur modellerna beter sig när samma fråga ställs om och om igen. I verkliga tillämpningar – precis som när cyberbrottslingar bombarderar kundtjänstbotar med liknande manipulationsförsök – kan detta leda till oförutsägbara fel.

APST-metoden visar att modeller som presterar lika bra i traditionella tester kan ha mycket olika säkerhetsrisker vid upprepad användning. Detta förklarar varför vissa företags chattbotar verkar robusta i testmiljöer men faller för relativt enkla manipulationsförsök i verkligheten.

Gränsen mellan forskning och verklighet

En tredje forskningsstudie lägger till ytterligare komplexitet genom att visa att så kallad aktivitetsstyrning – där forskare direkt manipulerar AI-modellers interna beräkningar – skapar artificiella tillstånd som aldrig kan uppnås genom vanliga textkommandon.

Detta är betydelsefullt eftersom det skapar en formell åtskillnad mellan vad som är möjligt genom direkt manipulation jämfört med vanlig promptning. För företag betyder det att vissa säkerhetstester kanske inte speglar verkliga hot, medan andra risker kan vara underskattade.

Disciplin över kapacitet

I denna nya verklighet blir arkitektonisk disciplin viktigare än rå AI-prestanda. Företag som framgångsrikt ska implementera generativ AI måste bygga in säkerhetsövervakning från dag ett, inte lägga till det i efterhand.

Det handlar om att designa system som förutsätter missbruk, inte hoppas på att det inte ska ske.

Vår analys

Detta markerar en kritisk vändpunkt för företags AI-implementering. Vi rör oss från "kan vi få AI att fungera?" till "hur skyddar vi våra AI-system från sofistikerade hot?"

Trenden pekar mot att AI-säkerhet blir lika viktig som traditionell cybersäkerhet – men med helt nya riskmönster. Kostnadsmissbruk genom AI-kapning kan påverka företags ekonomi direkt, inte bara deras data.

Framöver kommer vi se en ny bransch växa fram kring AI-säkerhetsövervakning och skydd. Företag som investerar i robust AI-arkitektur nu får konkurrensfördelar, medan de som behandlar säkerhet som en eftertanke riskerar både ekonomiska förluster och förtroendekriser.

Min rekommendation: Behandla varje extern AI-interaktion som en potentiell säkerhetsrisk och bygg övervakningssystem innan du skaluppar AI-tjänster till kunder.