Forskning visar: AI-modellers verkliga resonemang sker i dolda nätverkslager

AI-modellers verkliga resonemang sker i dolda lager vi inte förstår.

AI:s dolda tankevärld avslöjad: Modellerna resonerar inte där vi tror

I över ett år har vi fascinerats av ChatGPT och andra språkmodellers förmåga att 'tänka högt' genom så kallade tankekedjor – de steg-för-steg-förklaringar som modellerna ger när de löser komplexa problem. Men nu visar ny forskning från arXiv att vi kanske har missat poängen helt.

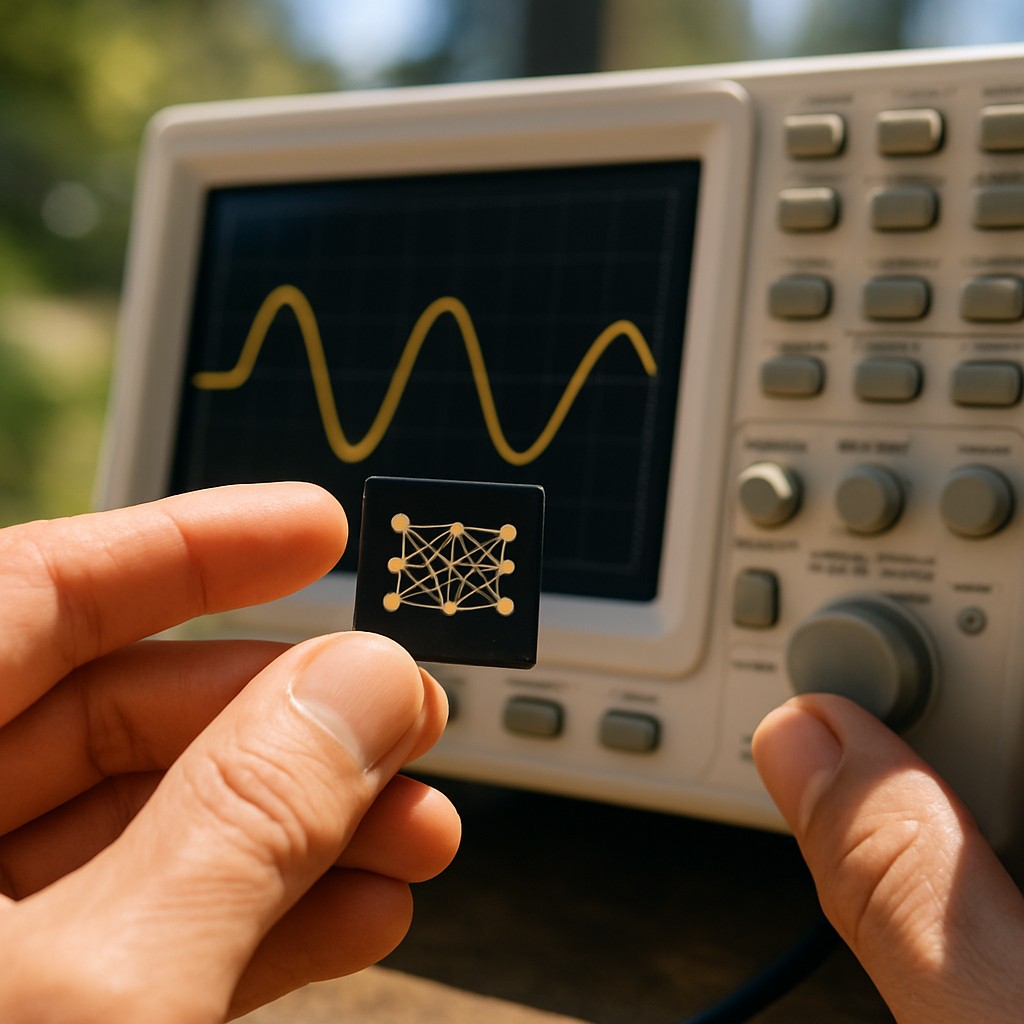

Forskarna har upptäckt att modellernas verkliga resonemang inte alls sker i dessa synliga tankekedjor, utan i de dolda tillstånden djupt inne i nätverkets lager. Det betyder att det vi tror är AI:s 'tankeprocess' egentligen bara är en yta – medan det verkliga arbetet pågår i processer vi inte kan se eller förstå.

Studien testade tre hypoteser om hur AI-resonemang fungerar: att det medieras av dolda tillstånd, av synliga tankekedjor, eller att förbättringar helt enkelt beror på mer beräkningskraft. Efter att ha granskat befintlig forskning fann forskarna starkast stöd för den första förklaringen – de dolda processerna.

Transparens som skenmanöver

Denna upptäckt får mig att tänka på hur vi bygger system. Som systemutvecklare vet jag att det ofta finns flera lager av abstraktion i komplexa system, men här handlar det om något djupare. Vi har trott att vi fått tillgång till AI:ns 'tankesätt', men det visar sig att vi bara sett toppen av isberget.

Problemet förvärras av att våra nuvarande metoder för att förklara AI-beslut ofta saknar vetenskaplig stringens, enligt parallell forskning. Verktyg som SHAP och andra populära förklaringsmetoder kan till och med vilseleda oss när vi fattar viktiga beslut baserat på AI-system. Inom områden som sjukvård och finans kan sådana missförstånd få allvarliga konsekvenser.

En intressant parallell hittar vi i Kanadas nya AI-register, som lanserades i november 2025 som ett försök till ökad transparens. Men även här visar forskning att registret systematiskt döljer den mänskliga bedömning och osäkerhetshantering som krävs för att använda AI-systemen. Istället för verklig transparens får vi tekniska beskrivningar som framställer AI som 'pålitliga verktyg' snarare än komplexa beslutsprocesser.

En ny förståelse krävs

Vad betyder detta för oss som bygger och använder AI-system? Först och främst måste vi acceptera att transparens inte är lika enkelt som vi hoppats. De synliga tankekedjorna kan vara värdefulla för användare, men de ger oss inte verklig insikt i hur modellerna faktiskt resonerar.

Forskarna föreslår att vi behöver fokusera mer på de dolda dynamiska processerna om vi verkligen vill förstå AI-reasoning. Det kräver nya verktyg och metoder – kanske mer likt hur vi analyserar komplexa system inom andra ingenjörsområden.

Det betyder inte att vi ska ge upp hoppet om förklarbar AI. Tvärtom behöver vi bli mer sofistikerade i vårt förhållningssätt. Istället för att nöja oss med ytliga förklaringar måste vi utveckla rigorösa, vetenskapligt grundade metoder för att verkligen förstå dessa system.

För mig som utvecklare är detta både utmanande och spännande. Det påminner om när vi först började förstå hur komplexa distribuerade system verkligen beter sig – vi behövde helt nya verktyg för monitorering och felsökning. Nu står vi inför en liknande utmaning med AI-system.

Vår analys

Denna forskning markerar en vändpunkt i vår förståelse av AI-system. Vi befinner oss i en situation som påminner om tidig mjukvaruutveckling – vi kan bygga system som fungerar, men vi förstår inte helt hur de gör det.

Det mest oroväckande är att våra nuvarande transparensinitiativ kanske ger en falsk trygghetskänsla. När regeringar och företag implementerar AI-register och förklaringsverktyg tror vi att vi får kontroll, men forskningen visar att vi kanske bara skapar en illusion av förståelse.

Framåt behöver vi investera mer i grundforskning om AI-systems interna dynamik. Det räcker inte med att fokusera på prestanda och användargränssnitt – vi måste förstå de underliggande processerna. Detta kommer att kräva tätare samarbete mellan AI-forskare, kognitiva vetenskaper och systemdesign.

Långsiktigt tror jag att denna insikt kommer att leda till bättre AI-system, inte sämre. När vi förstår var det verkliga 'tänkandet' sker kan vi designa mer tillförlitliga och kontrollerbar system. Men vägen dit kommer att kräva ödmjukhet och betydligt mer sofistikerade verktyg än vi har idag.