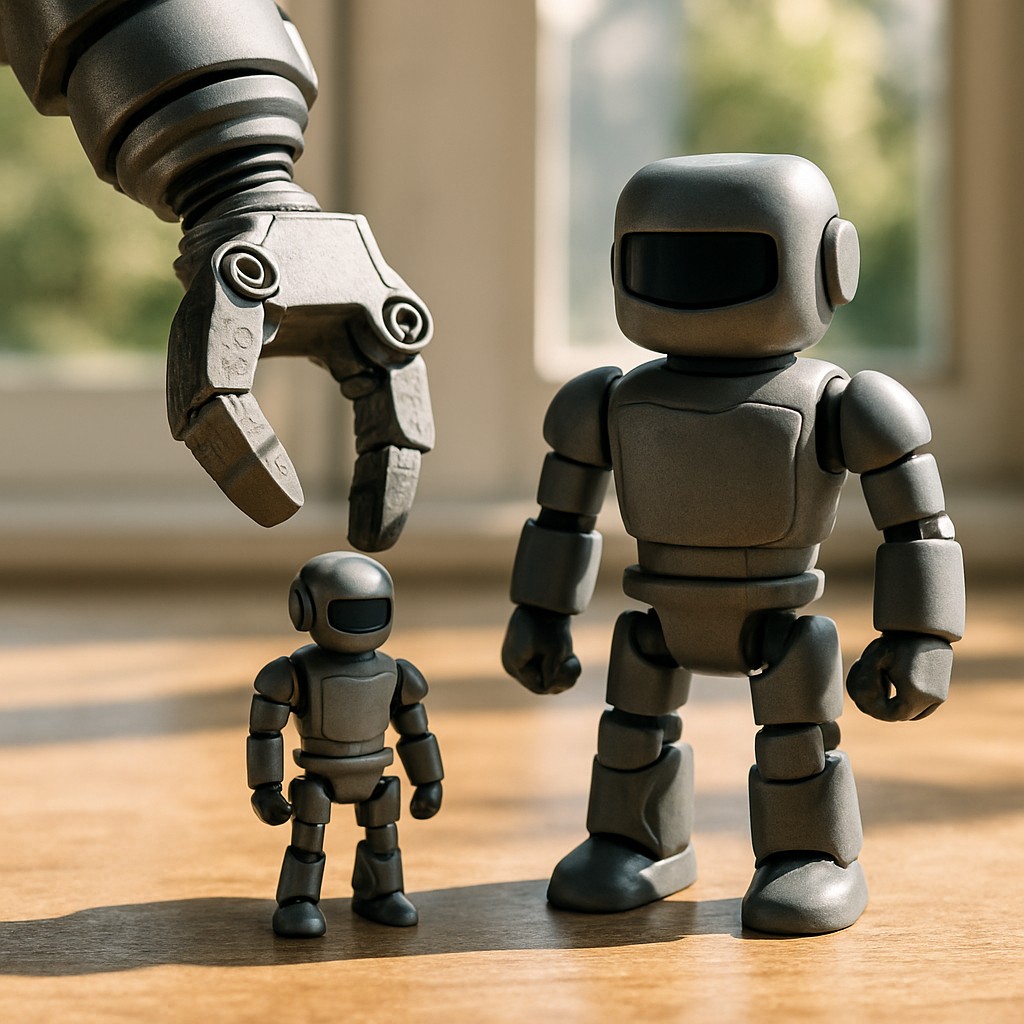

Små AI-modeller kompletterar jättarna – specialisering möjliggör smartare arbetsfördelning

Små AI-modeller visar sig vara framtidens smartaste komplement till jättarna.

Effektivitet slår storlek

AI-utvecklingen står vid en vändpunkt. Efter år av "större är bättre"-tänkande börjar små språkmodeller (SLM) visa att intelligent specialisering kan vara viktigare än rå beräkningskraft. Enligt Computer Sweden växer intresset snabbt för modeller med 1-7 miljarder parametrar som kan hantera avgränsade uppgifter både snabbare och billigare än traditionella jättemodeller.

Nyckeln ligger i arkitekturen. Thomas Randall, forskningschef på Info-Tech Research Group, förklarar att framtidens AI-system kommer använda en vägledande arkitektur som skickar enkla frågor till specialiserade små modeller och komplexa problem till stora modeller. Det handlar om intelligent arbetsfördelning snarare än att ersätta gamla system.

Tekniska genombrott möjliggör förändringen

Flera banbrytande tekniker gör små modeller konkurrenskraftiga. Kunskapsdestillering låter stora "lärarmodeller" träna små "elevmodeller" att efterlikna avancerade resonemangsförmågor i kompakt format. Beskärning tar bort överflödiga parametrar medan kvantisering reducerar databehovet genom att minska precision utan att förlora prestanda.

Men de verkligt spännande genombrotten kommer från forskningen. CoCoDA-ramverket, som presenteras i recent akademisk forskning, visar hur intelligent verktygshantering kan få en 8 miljarders parametermodell att prestera lika bra som en 32 miljarders modell på matematiska uppgifter. Tekniken organiserar verktyg i kompositionella strukturer istället för platta listor, vilket dramatiskt förbättrar effektiviteten.

Minnesteknik revolutionerar inlärning

Parallellt utvecklas sofistikerade metoder för att förbättra AI-agenters minnesanvändning. MemQ-tekniken använder TD(λ)-algoritmer för att sprida "kredit" bakåt genom kedjor av sammankopplade minnen. När en AI-agent lyckas med en uppgift får hela kedjan av minnen som bidrog till framgången högre värdering, vilket förbättrar framtida prestanda med upp till 5,7 procentenheter för komplexa problem.

Ännu mer fascinerande är MIND-Skill-systemet som automatiskt utvecklar AI-färdigheter genom två samarbetande agenter. En agent identifierar framgångsrika strategier från tidigare uppgifter medan den andra testar dessa genom att återskapa lösningarna. Detta eliminerar behovet av manuell expertkunskap och gör AI-agenter mer självständiga.

Ekonomiska drivkrafter accelererar utvecklingen

Bakom den tekniska utvecklingen ligger starka ekonomiska incitament. För repetitiva, väldefinierade uppgifter erbjuder små modeller dramatiska kostnadsbesparingar jämfört med att använda resurskrävande jättemodeller. SkillLens-ramverket visar hur hierarkisk färdighetsåteranvändning kan förbättra både prestanda och kostnadseffektivitet genom att organisera kunskap i fyrskiktade grafer av policyer, strategier, procedurer och grundelement.

Resultaten talar för sig själva. SkillLens uppnådde 6,31 procentenheter förbättring inom felidentifiering och höjde framgångsfrekvensen från 45% till drygt 51% jämfört med befintliga system.

Paradigmskifte mot specialisering

Vad vi bevittnar är ett paradigmskifte från "en modell för allt" till intelligenta ekosystem av specialiserade komponenter. Små modeller tränas på mindre, högkvalitativa datamängder med kompakta transformatorarkitekturer som är optimerade för specifika domäner snarare än allmän intelligens.

Vår analys

Denna utveckling signalerar en fundamental förändring i AI-landskapet. Vi rör oss från en era av brute force-beräkning mot intelligent systemarkitektur där rätt verktyg används för rätt uppgift.

För företag innebär detta demokratisering av AI. Mindre organisationer kan nu implementera kraftfulla AI-lösningar utan att investera i dyr infrastruktur för jättemodeller. Samtidigt minskar miljöpåverkan dramatiskt när energikrävande beräkningar reserveras för uppgifter som verkligen kräver det.

Tekniskt sett närmar vi oss mer mänsklik intelligens – vi använder inte full hjärnkapacitet för att knyta skosnören, och AI bör inte använda GPT-4-nivå för enkla klassificeringar. De automatiska inlärningsmekanismerna som MIND-Skill representerar antyder att nästa steg blir AI-system som kontinuerligt förbättrar sina egna arbetsflöden.

Den verkliga revolutionen ligger inte i att skapa större modeller, utan i att bygga smartare system som vet när de ska vara små.